추론 및 다국어 작업 등 역량 고도화한 최신 LLM 제품군

[아이티데일리] 알리바바(Alibaba) 그룹의 디지털 기술 핵심인 알리바바 클라우드(Alibaba Cloud)가 대규모언어모델(LLM) 제품군의 최신 세대이자 자사 최초 하이브리드 추론 모델인 ‘큐원3(Qwen3)’을 공개했다.

큐원3 시리즈는 6개의 밀집(dense) 모델과 2개의 전문가혼합(MoE) 모델로 구성됐다. 이를 바탕으로 모바일 기기, 스마트 글래스, 자율주행차, 로보틱스 등 차세대 애플리케이션 개발을 위한 유연성을 제공한다. 현재 큐원3 모델은 오픈소스로 제공돼 전 세계 누구나 이용할 수 있다.

큐원3는 기존 LLM 기능과 고급형 동적 추론을 결합한 모델이다. 코딩, 논리적 추론과 같은 복잡한 다단계 작업을 위한 사고 모드와 빠른 범용 응답을 위한 비사고 모드 간의 전환을 원활하게 할 수 있다. 알리바바 클라우드에 따르면, 큐원3는 이전 모델인 ‘큐원3(Qwen2.5)’의 2배 규모인 36조 개에 달하는 방대한 데이터 셋을 학습했으며 추론, 지시 수행, 다국어 작업 등 여러 분야에서 성능이 대폭 향상된 것으로 나타났다. 애플리케이션 프로그램 인터페이스(API)를 통해 큐원3에 접근하는 개발자는 최대 3만8천 개의 토큰까지 사고 지속 시간을 세밀하게 조정이 가능하며, 이를 통해 지능형 성능과 컴퓨팅 효율성 간 균형을 최적화할 수 있다.

세부 기능을 살펴보면 우선 119개의 언어와 방언을 지원해 다국어 역량을 강화했다. 모델 컨텍스트 프로토콜(MCP) 지원 및 강력한 함수호출(function-calling) 기능을 통해 복잡한 인공지능(AI) 에이전트 기반 작업을 효율적으로 수행할 수 있도록 지원하며, 수학·코딩 등을 위한 추론 성능과 창의적 글쓰기, 롤플레잉 등 자연스러운 대화를 위한 인간친화성도 향상됐다.

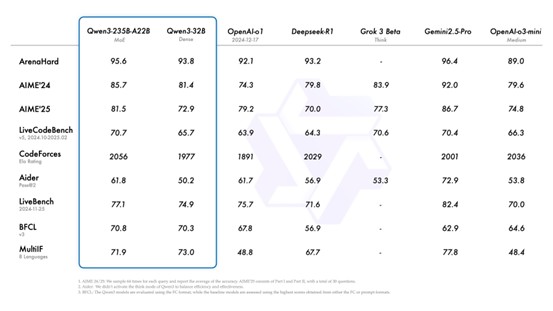

또한 추론 모델 개발을 위해 △긴 연쇄사고(long chain-of-thought) 초기학습(cold start) △추론 기반 강화 학습(Reinforcement learning) △사고 모드 융합 △일반 강화 학습 등 4단계 학습 과정을 구현했다. 업계 벤치마크 평가도 긍정적이다. 큐원3는 수학적 추론(AIME25), 코딩역량(LiveCodeBench) 등 다양한 업계 벤치마크에서 최고 수준의 결과를 달성한 것으로 파악됐다.

한편 큐원3는 현재 허깅페이스(Hugging Face), 깃허브(GitHub), 모델스코프(ModelScope)를 통해 무료로 다운로드할 수 있다. 알리바바의 AI 모델 개발 플랫폼인 모델 스튜디오(Model Studio)를 통해서도 곧 API 접근이 가능해질 예정이다. 큐원3는 알리바바의 플래그십 AI 슈퍼 어시스턴트 애플리케이션 ‘쿼크(Quark)’를 구동할 수 있다.