P6e-GB200, 블랙웰 GPU 72개·360PF 연산 성능 ‘눈길’

[아이티데일리] 아마존웹서비스(AWS)는 추론 모델과 에이전틱 AI 시스템 등 새로운 AI 기술 발전을 위해, ‘엔비디아 그레이스 블랙웰 슈퍼칩(NVIDIA Grace Blackwell Superchips)’으로 구동되는 ‘P6e-GB200 울트라서버(P6e-GB200 UltraServers)’를 출시했다. P6e-GB200 울트라서버는 규모가 크고 정교한 AI 모델의 훈련‧배포를 위해 설계됐다.

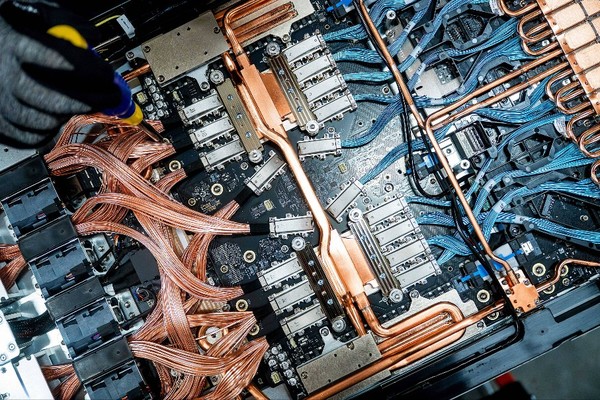

P6e-GB200 울트라서버는 최대 72개의 엔비디아 블랙웰 그래픽처리장치(GPU)가 탑재되고, 5세대 엔비디아 NV링크(NVIDIA NVLink)를 통해 상호 연결된다. NV링크는 엔비디아가 개발한 와이어 기반 통신 링크다. 여러 개의 GPU들이 서로 빠르게 데이터를 주고 받을 수 있도록 지원한다.

각 울트라서버는 360페타플롭스(petaflops)의 FP8 고밀도 컴퓨팅과 13.4테라바이트(TB)의 고대역폭 GPU 메모리(HBM3e)를 지원한다. AWS는 자사 클라우드 GPU 서버인 ‘P5en 인스턴스’와 비교해 해당 울트라서버가 단일 NV링크 도메인에서 20배 이상의 컴퓨팅 성능과 11배 이상의 메모리를 제공한다고 설명했다.

AWS는 올해 초, 다양한 AI 및 고성능 컴퓨팅(HPC) 워크로드를 위해 엔비디아 블랙웰 GPU로 구동되는 ‘P6-B200 인스턴스(P6-B200 Instances)’를 출시한 바 있다. AWS는 P6-B200 인스턴스가 다양한 AI 활용 사례에 유연하게 대응할 수 있다고 강조했다. 각 인스턴스는 △NV링크로 상호 연결된 8개의 엔비디아 블랙웰 GPU △1.4TB의 고대역폭 GPU 메모리 △5세대 인텔 제온 스케일러블 프로세서(Intel Xeon Scalable processors) 등을 제공한다.

구체적인 워크로드 요구사항과 아키텍처 요구사항에 따라 P6e-GB200과 P6-B200를 선택할 수 있다. P6e-GB200 울트라서버는 조 단위 매개변수(trillion-parameter) 규모의 프론티어 모델 훈련 및 배포와 같은 컴퓨팅 및 메모리 집약적인 AI 워크로드에 적합하다는 게 회사의 설명이다. 엔비디아 GB200 NVL72 아키텍처를 통해 GPU 노드 간 통신 오버헤드를 줄여 더 효율적인 분산 훈련을 지원할 수 있다. 회사는 추론 워크로드의 경우, 1조 개 파라미터 모델을 단일 NV링크 도메인 내에 완전히 포함할 수 있어 대규모 환경에서도 더 빠르고 일관된 응답 시간을 제공한다고 밝혔다.

AWS에 따르면 P6-B200 인스턴스는 광범위한 AI 워크로드를 지원하며 중대형 규모의 훈련 및 추론 워크로드에 적합하다. 기존 GPU 워크로드를 이식하려는 경우, P6-B200 인스턴스는 코드 변경을 최소화하고 현재 세대 인스턴스로부터의 마이그레이션을 간소화하는 친숙한 8-GPU 구성을 제공한다고 설명했다.

한편 P6e-GB200 울트라서버는 엔비디아 DGX 클라우드(NVIDIA DGX Cloud)를 통해서도 제공될 예정이다. DGX 클라우드는 다중 노드 AI 훈련 및 추론 기능과 엔비디아의 AI 소프트웨어 스택을 기반으로 하는 AI 플랫폼이다. 유연한 이용 기간 옵션과 엔비디아 전문가의 포괄적인 지원 및 서비스를 제공할 계획이다.