한국어 AI 데이터 신뢰성 및 안전성 강화 위해 ‘AI허브’에 개방

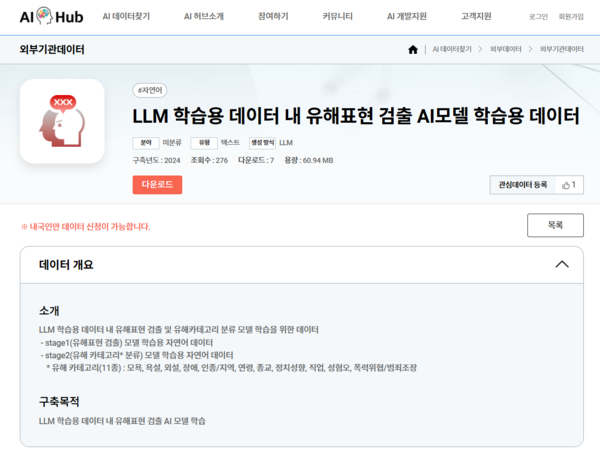

[아이티데일리] 한국지능정보사회진흥원(NIA)과 한국정보통신기술협회(TTA)가 대형언어모델(LLM)의 신뢰성과 안전성을 높이기 위해 AI 허브를 통해 유해 표현 검출 모델과 학습 데이터를 공개했다.

이번 발표는 과학기술정보통신부 초거대 인공지능(AI) 확산 생태계 조성 사업의 일환으로 이루어졌다.

NIA와 TTA가 공개한 AI 모델은 말뭉치 데이터 내 유해 표현을 검출하고 이를 다양한 카테고리로 분류하는 기능을 수행한다. 이를 위해 구축된 데이터는 총 41만 건으로, 유해 표현 검출용 데이터 20만 건과 카테고리 구분용 데이터 21만 건으로 구성됐다. 해당 데이터는 한국어 유해 표현 오픈소스 자료를 기반으로 AI 허브의 구어체 및 문어체 데이터를 활용해 문체 다양성을 확보했다.

특히 국가인권위원회의 혐오 표현 안내서와 KISO의 자율정책 가이드라인을 참조해 유해 표현을 11개 카테고리로 명확히 정의했다. 상세 카테고리는 명예훼손(모욕, 욕설, 외설), 차별적 성격(인종/지역, 장애, 연령 등), 폭력적 성격(폭력위협/범죄조장)으로 분류된다. 이러한 체계적 정의와 재가공을 통해 데이터의 일관성과 신뢰성을 확보했다.

NIA는 이번 모델과 데이터를 AI 허브에 개방해 누구나 활용할 수 있도록 했다. 이를 통해 AI 생성 콘텐츠의 안전성을 강화하고 다양한 산업 분야에서 윤리적 AI 생태계 조성에 기여할 것으로 기대된다.

NIA 황종성 원장은 “AI 기술의 발전은 기술적 진보뿐만 아니라 윤리적 고려가 병행돼야 한다. 이번 공개가 한국어 LLM의 신뢰성과 안전성을 강화하는 계기가 될 것”이라면서 “NIA는 앞으로도 양질의 데이터를 구축하며 국내 AI 생태계를 적극 지원하겠다”고 말했다.